About

标题

Sequential Graph Convolutional Network for Active Learning

用于主动学习的序列图卷积网络

发表

2021 CVPR

作者

Razvan Caramalau:伦敦帝国理工学院

Binod Bhattarai:伦敦帝国理工学院 博士后

Tae-Kyun Kim:伦敦帝国理工学院 副教授 | 韩国科学技术院

团队

伦敦帝国理工学院 电子电器学院

支持

Huawei Technologies Co.

UKRI EPSRC Programme Grant

关键点

图像分类、三维手势估计

Related

GNN

- 计算loss优化参数进行分类 2. 通过对比两个节点的特征进行关联预测

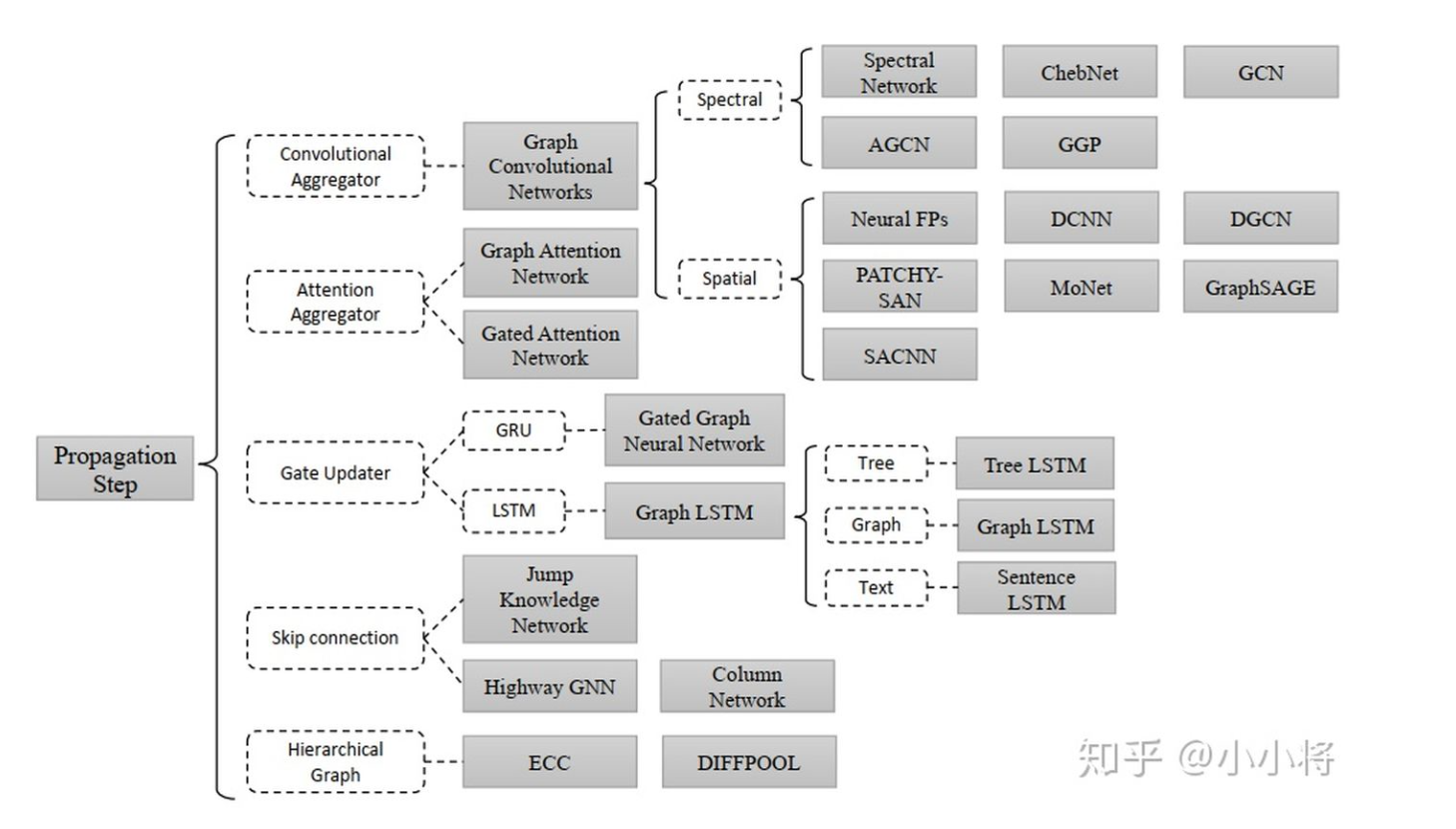

归根到底,GNN就是特征提取的方法。如果按照 \(f\) 分类,其可以分成以下类型:

GCN

https://zhuanlan.zhihu.com/p/112277874

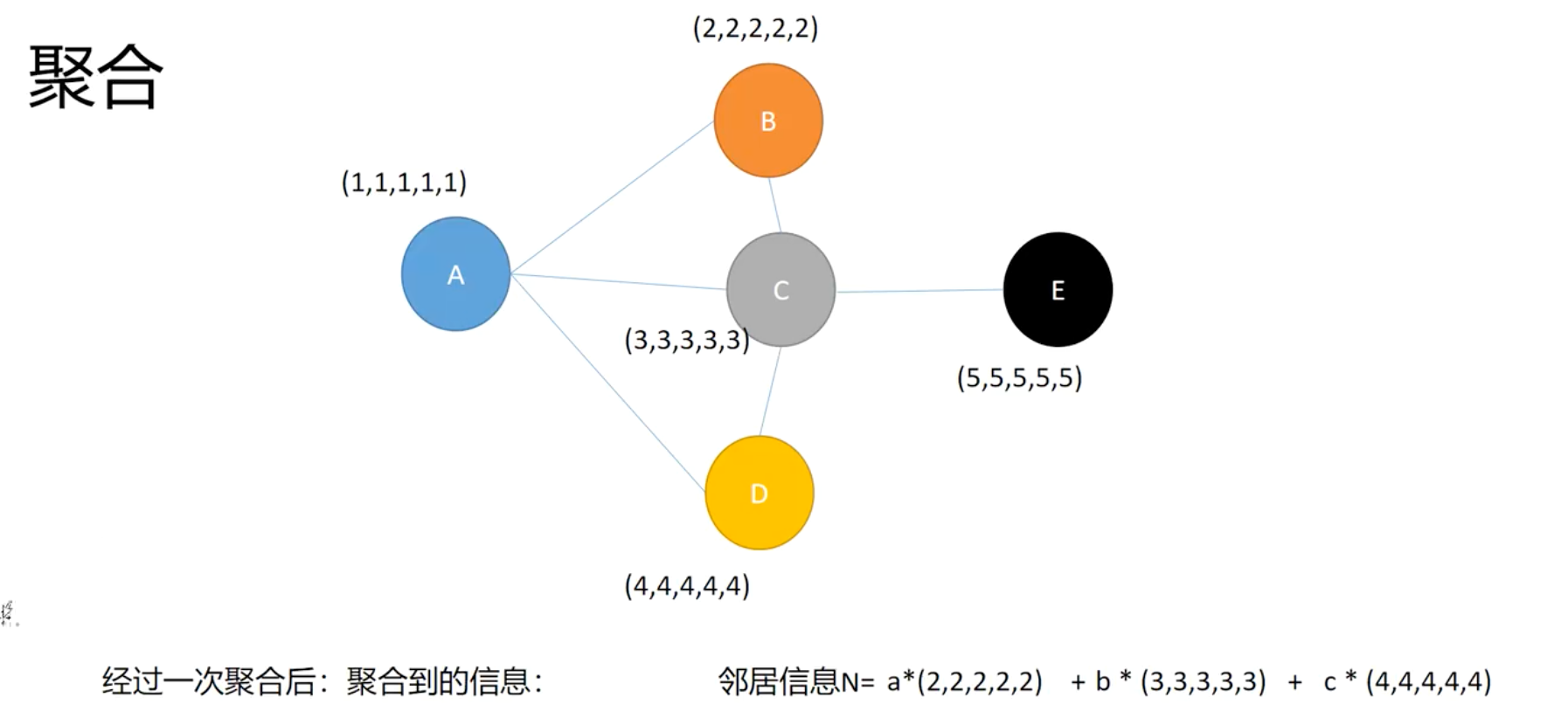

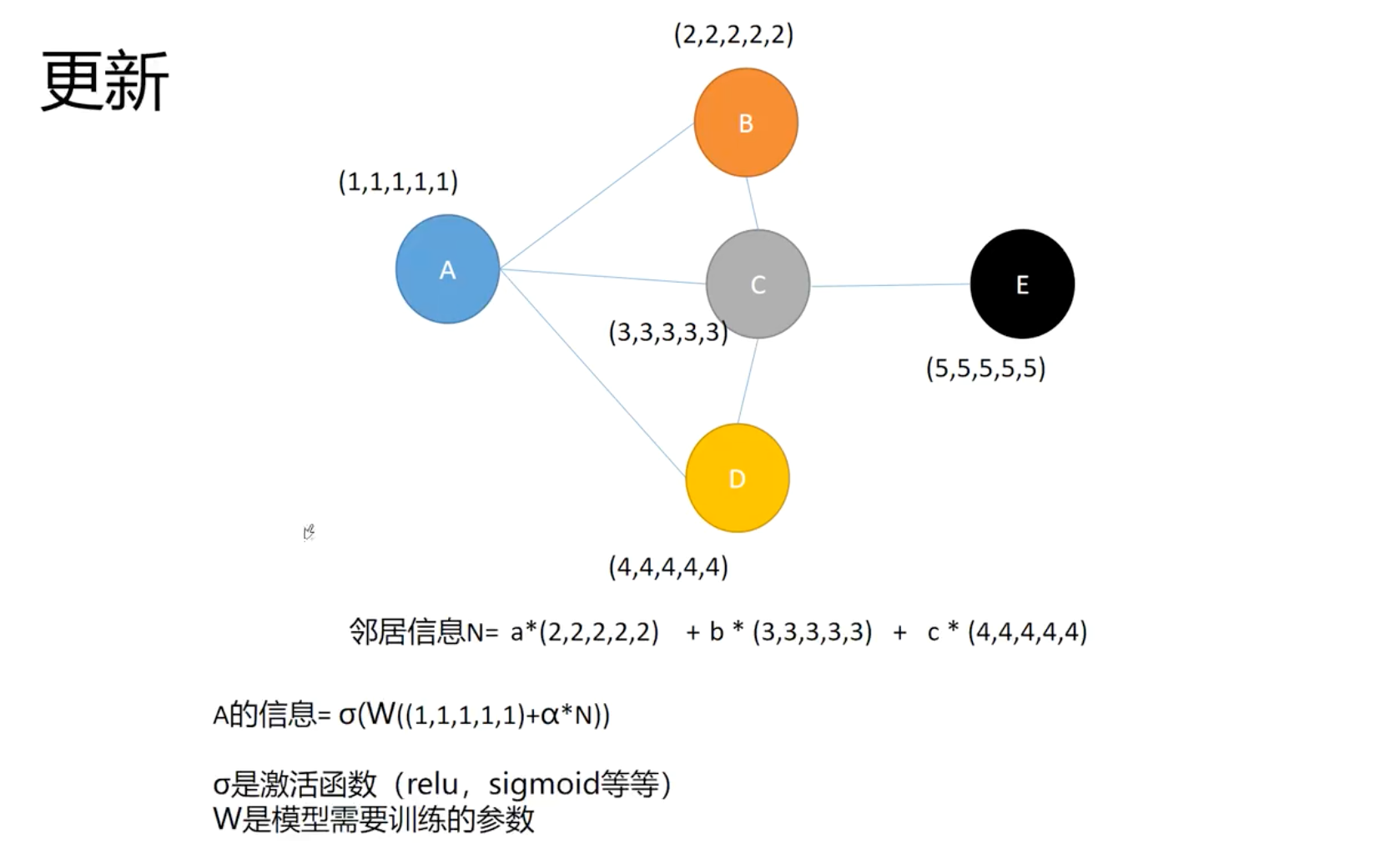

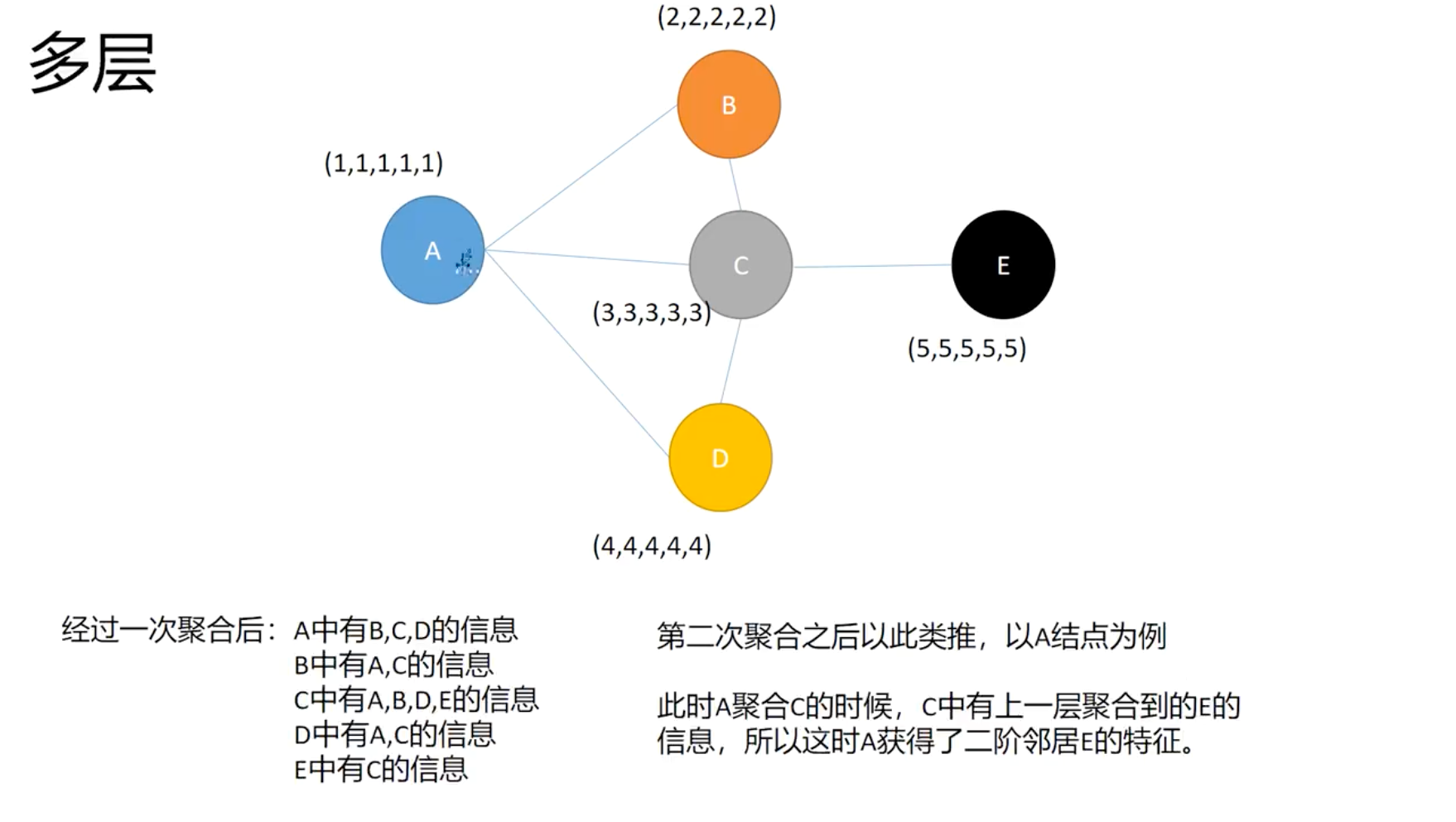

聚合:平均法

邻居的平均 + 单位矩阵(身份矩阵/自己的特征)

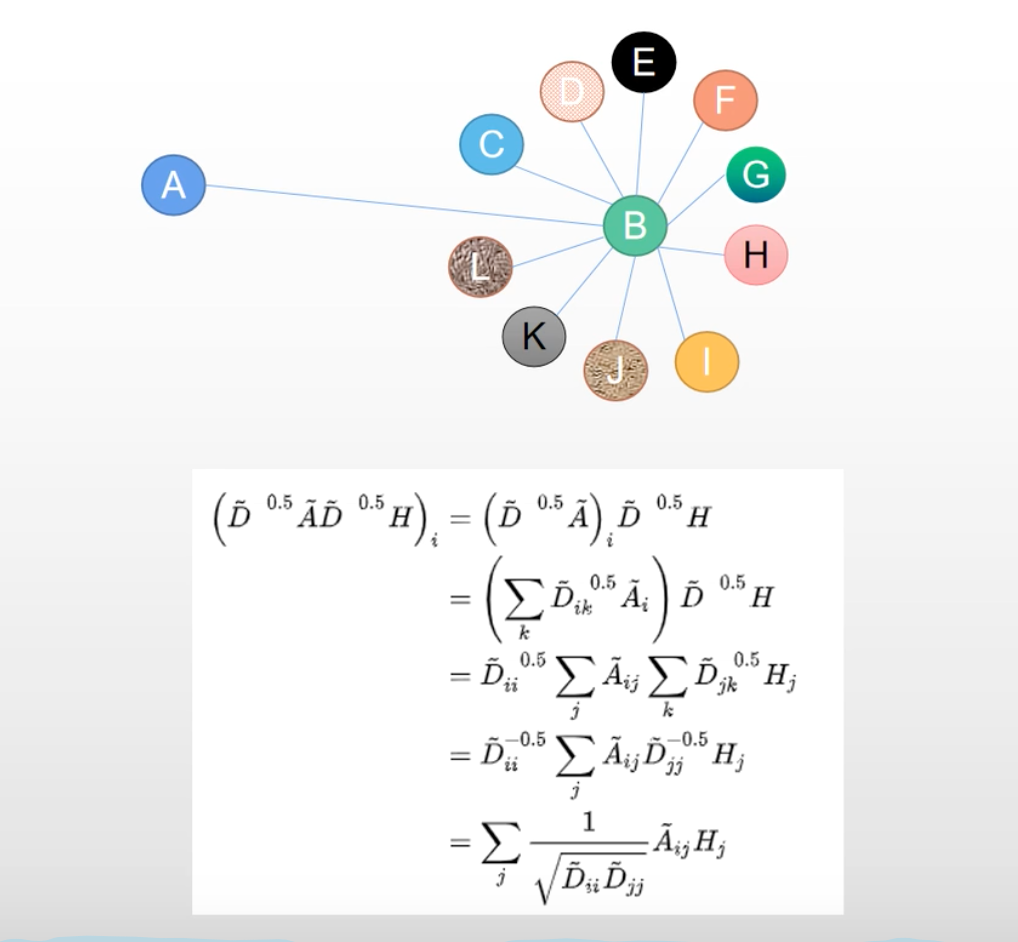

平均法问题及解决

主动学习 Active Learning

- 学习者 learner:被训练来最小化目标任务的模型

- 采样者 sampler:在固定预算内选择有代表性的未标记的例子

- 注释者 annotator:给查询的数据贴上标签

分类:任务依赖型(task-dependent)和任务诊断型( task-agnostic)

Content

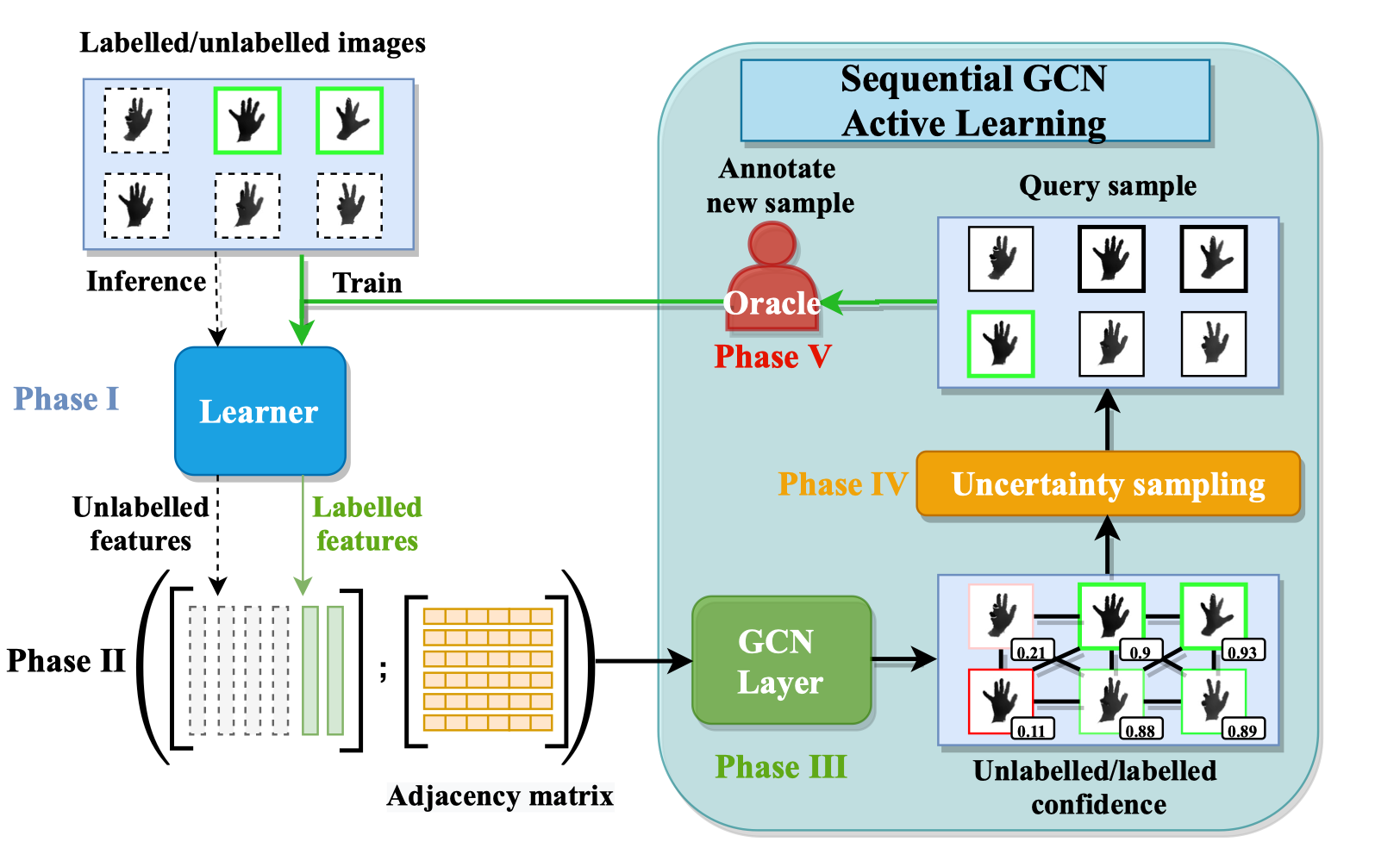

方法

learner -- 提取特征

本文的学习者同时考虑了分类和回归任务

分类任务 :

一个CNN图像分类器,可以用任意深度模型(ResNet-18)

回归任务:

本文为解决3D手势问题(从深度图像中估计手部关节的三维坐标),使用了一个众所周的的DeepPrior框架做模型

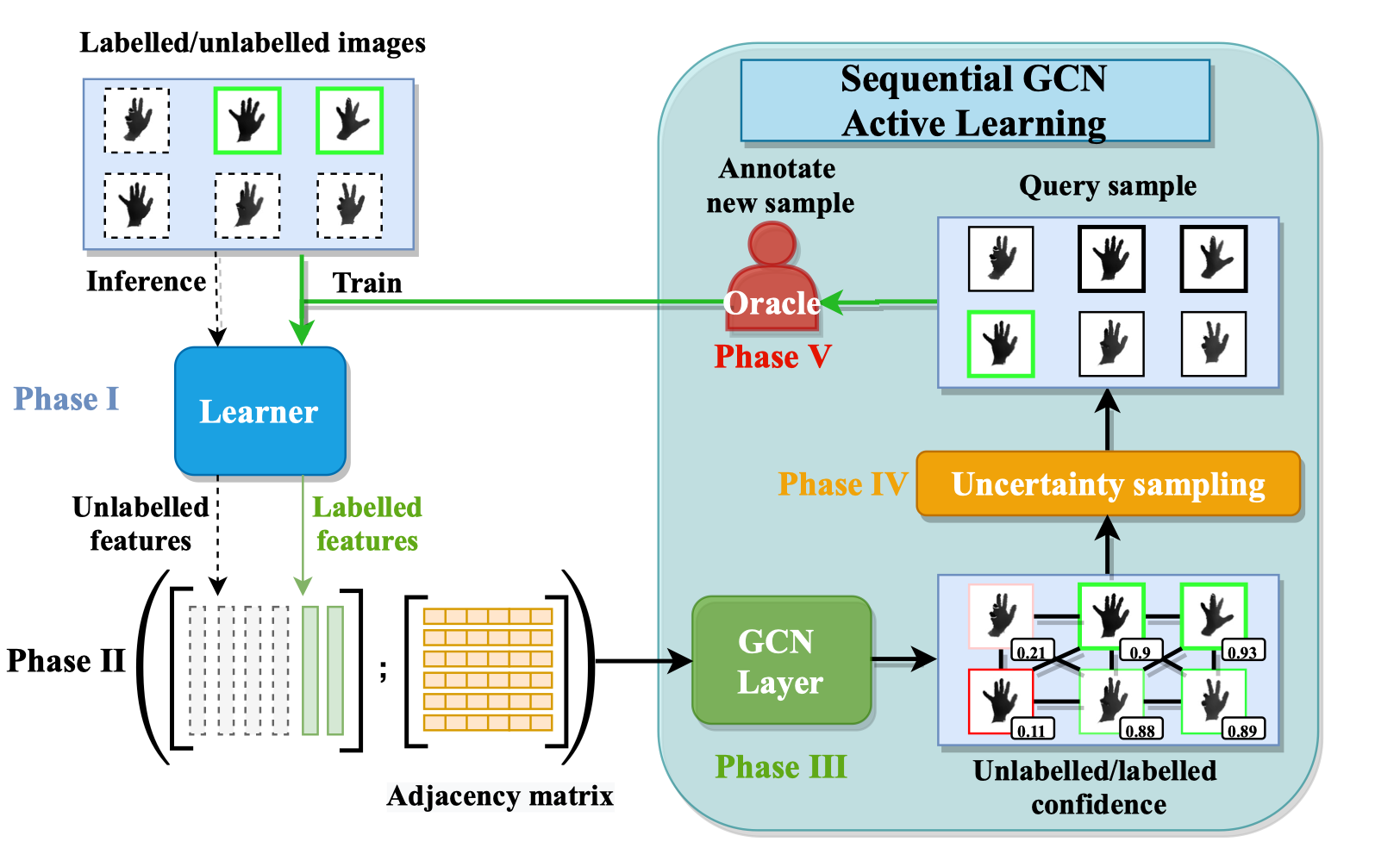

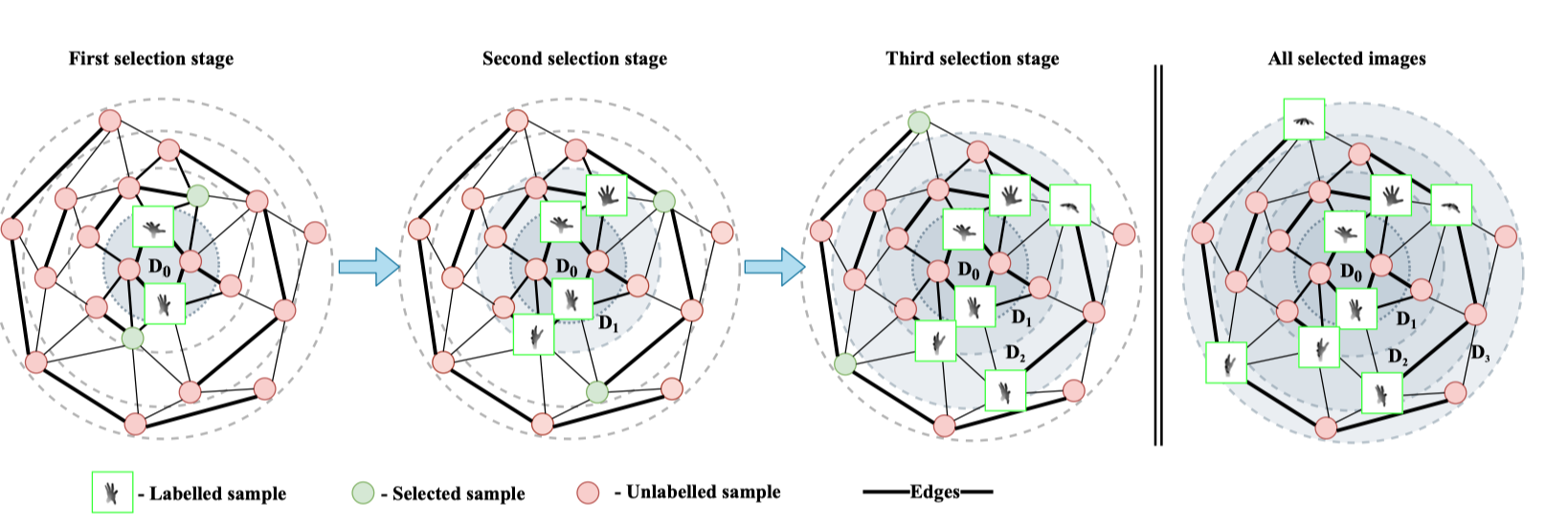

sampler -- UncertainGCN / CoreGCN

- 采用最近流行的 pool-based 方法:从unlabeled的数据集中随机选择一组数据进行labelling

目的是为了最小化 Active Learning stages,以便更少的样本需要被注释

-

为了避免over-smoothing,使用了一个两层结构:\( f_g = σ(θ_2(ReLU(θ_1A)A))\)

- 第一个是正常GCN层 + 一个修正线性单元激活(rectified linear unit activation)

- 第二个是一个sigmoid激活函数

实验中还使用了dropout

-

训练好GCN后开始进行选择

- UncertainGCN方法:选择分数最接近0的样本

- CoreGCN方法(高性能):基于CoreSet,计算设置在GCN第一层结构后特征的欧式距离

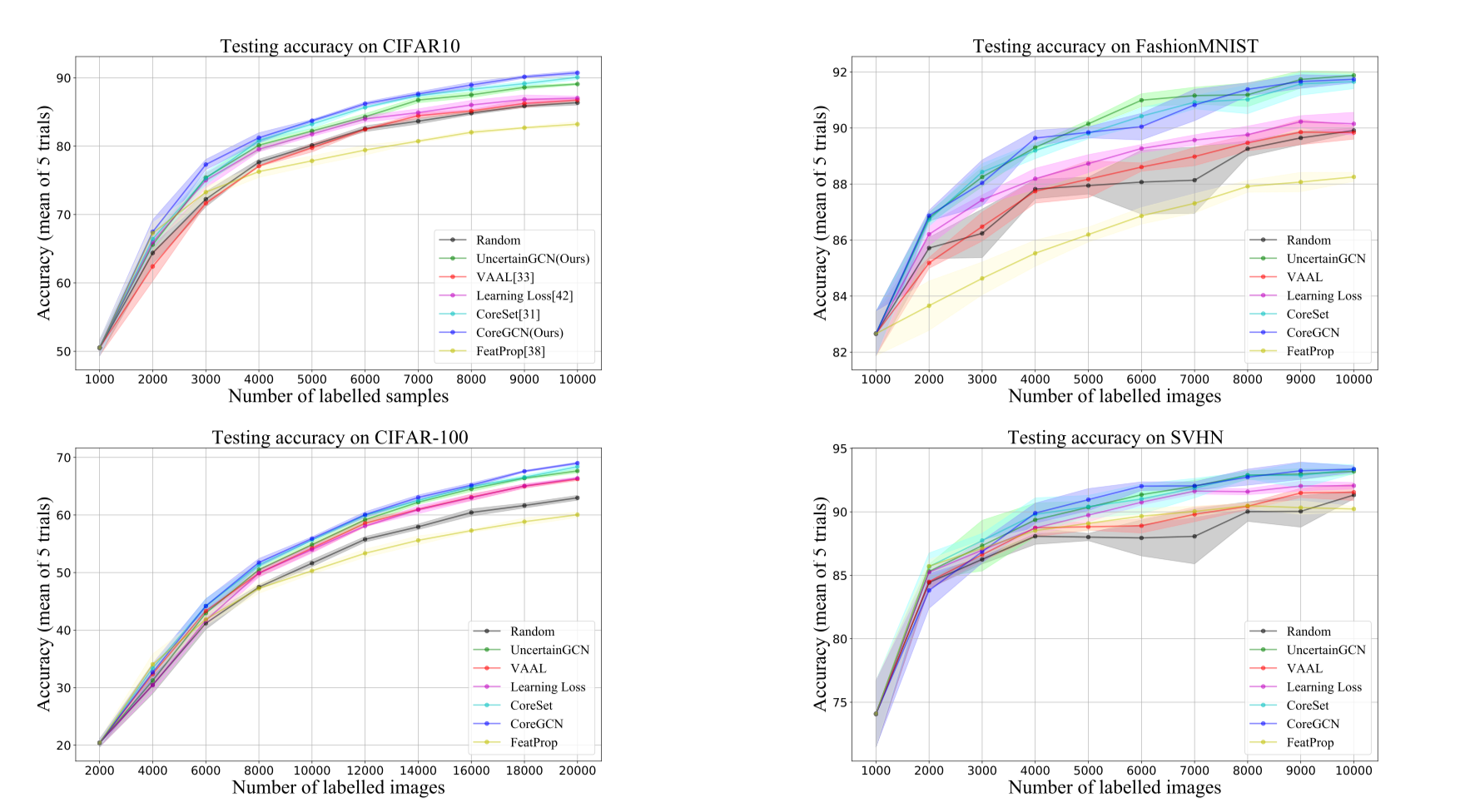

实验

分类任务